摘要:

主要内容(新澳好彩免费资料查询)斯坦福炒虾机器人团队联合谷歌推出全新自主导航基础模型给机器人安上「最强大脑」,可想而知,用在RT-2机器人身上有多么无敌。首先需要的是环境演示路线,...

摘要:

主要内容(新澳好彩免费资料查询)斯坦福炒虾机器人团队联合谷歌推出全新自主导航基础模型给机器人安上「最强大脑」,可想而知,用在RT-2机器人身上有多么无敌。首先需要的是环境演示路线,... 半年后,原团队联合谷歌研究人员推出了全新的机器人自主导航基础模型——VLA。

与以往不同的是,全新架构背后是谷歌迄今为止性能最强的1.5 Pro大机型。

1.5 Pro不仅拥有100k长上下文,还拥有强大的多模态能力,给机器人装上“最强大脑”,可想而知用在RT-2机器人上会有多么的无敌。

在观看了 9000 平方英尺的谷歌办公室的视频后,RT-2 机器人形成了如何感知整个环境的概念。

接下来就是RT-2大显身手的时候了。

首先,让 RT-2 带您去一个可以画东西的地方。

“好的,给我一分钟考虑一下,”这个戴着可爱黄色领结的机器人回答道。

过了一会儿,它把人类带到了一面墙大小的白板前。

随后,它再次接到新的命令,按照白板上指示的路线图,到达“蓝色区域”。

RT-2又想了想,然后走了很长一段路,终于来到了机器人测试区。

不仅如此,研究人员还主动带 RT-2 参观了 Lewis 的办公桌和临时办公桌区域,然后请 RT-2 带路。

可以看出RT-2记忆能力很强,能够准确识别位置。

50 条指令,完成率 90%

RT-2之所以能顺利完成上述任务主要内容(新澳好彩免费资料查询)斯坦福炒虾机器人团队联合谷歌推出全新自主导航基础模型,秘诀在于利用机器人的导航系统进行训练。

具体做法是,拍摄指定区域(如家庭或办公空间)的视频巡视,让1.5 Pro驱动的机器人“观看”视频来了解环境。

接下来利用VLA将环境理解与常识推理能力结合起来。

然后,机器人可以根据其观察和学习到的内容对书面和口头命令以及手势做出响应。

例如,当用户展示手机并询问“在哪里可以充电”后,机器人会引导用户找到电源插座。

这意味着在一定的空间内,被驱动的机器人可以完成50多个用户指令,成功率高达90%。

研究人员还发现,1.5 Pro可以让机器人规划如何完成导航以外的指令。

例如,一个人的办公桌上有两排空的快乐水瓶子2024年新奥门开奖结果,他想要再来一瓶,于是他问机器人他最喜欢的饮料是否有货。

该团队表示,机器人应该导航到冰箱,检查是否有可乐,然后返回向用户报告结果。

表示研究团队将进一步研究这些机器人反馈的结果。

目前,机器人处理这些指令大约需要10-30秒的时间,这对于实际应用来说太慢了,而且响应速度还有提升空间。

甚大拉

在导航研究领域,一个难以实现的目标是构建一个能够理解自然语言和图像等多模态指令并执行有效导航的智能代理。

为了实现这一目标,研究人员提出了一项广泛使用的导航任务——带有游览的多模式指令导航(MINT)。

在此任务中,环境信息是通过预先录制的演示视频提供的。

论文地址:

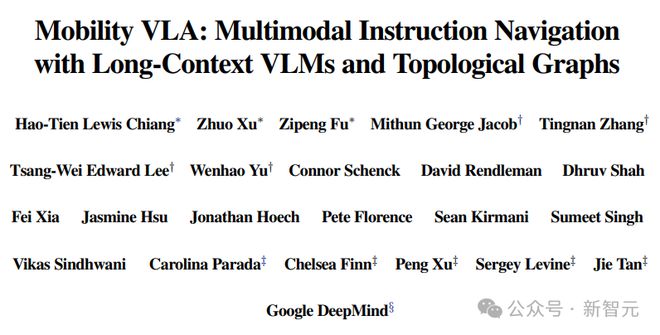

为了解决 MINT 任务,研究人员进一步提出了一种分层的视觉-语言-动作 (VLA) 导航策略 VLA,它将长上下文 VLM 的环境理解和常识推理能力与基于拓扑图的强大的低级导航策略相结合。

高层策略使用长上下文 VLM,以演示路线视频和多模态用户指令为输入,在演示视频中找到目标帧。接下来,低层策略使用目标帧和离线构建的拓扑图在每个时间步骤生成机器人动作。

在 836 平方米的真实环境中的评估结果表明,VLA 在之前未解决的多模态指令(例如,拿着一个塑料盒时问“我应该把它放在哪里?”)上实现了较高的端到端成功率。

如图1所示,VLA是一种分层导航策略,包括在线和离线两部分。

在离线阶段,根据演示路线(N,F)生成拓扑图G,在线阶段,高层策略利用演示路线和多模态用户指令(d,I)找到导航目标框架的索引g。

接下来,低级策略使用拓扑图、当前摄像机观察 O 和目标帧索引 g 来生成路径点动作 a,供机器人在每个时间步执行。

演示路线和离线拓扑图生成

首先需要的是在环境中的演示路线,可以由人类用户通过远程操作提供,或者简单地通过在环境中行走时用智能手机录制视频来提供。

然后,VLA 离线构建一个拓扑图 G = (V, E),其中每个顶点 vi∈V 对应演示路线视频 (F, N) 中的一个帧 fi。

使用这种现成的运动结构管道,可以为每一帧确定一个近似的六自由度(6-of-)相机姿势并将其存储在顶点中。

接下来,如果目标顶点位于源顶点“前方”(与源顶点的夹角小于 90 度)且在 2 米以内,则向 G 添加有向边。

与传统的导航流程(例如,首先绘制环境地图,然后识别可穿越区域,最后构建 PRM)相比,地图弹出方法要简单得多,因为它可以根据旅行轨迹捕捉环境的一般连通性。

使用长上下文多模态 VLM 进行高级对象查找

在线执行期间,高级策略利用 VLM 的常识推理能力,从符合各种多模式、口语化且通常模糊的用户指令的演示路线中识别导航目标。

为此,研究人员准备了一个由交错的文本和图像组成的提示 P(F,N,d,I)。

以下是表1中多模式用户指令“我应该把这个放在哪里?”的具体P示例:

You are a robot operating in a building and your task is to respond to the user command about going to a specific location by finding the closest frame in the tour video to navigate to .

These frames are from the tour of the building last year .

[ Frame 1 Image f1]

Frame 1. [ Frame narrative n1]

...

[ Frame k Image fk ]

Frame k . [ Frame narrative nk ]

This image is what you see now . You may or may not see the user in this image . [ Image Instruction I]

The user says : Where should I return this ?

How would you respond ? Can you find the closest frame ?此时VLM以整数形式返回目标帧索引g。

使用拓扑图实现低级目标到达

一旦高级策略识别出目标帧索引 g,低级策略(算法 1)就会接管并在每个时间步骤生成一个航点动作(公式 1)。

对于每个时间步,使用实时分层视觉定位系统根据当前摄像机观测值 O 来估计机器人姿态 T 和最近的起始顶点 vs∈G。

该定位系统根据全局描述子在拓扑图G中找到k个距离最近的候选框,然后通过PnP计算出机器人的姿态T。

接下来算法(第 9 行)在拓扑图上寻找从起始顶点 vs 到目标顶点 vg(即目标框索引 g 对应的顶点)的最短路径 S。

最后,低级策略返回一个航点动作,该动作只是路径 S 中下一个顶点 v1 相对于当前姿势 T 的平移 ∆x、∆y 和旋转 ∆θ(第 10 行)。

实验

为了探索 VLA 的性能,研究人员针对以下三个问题设计了实验。

RQ1:VLA 在现实世界的 MINT 中表现如何?

RQ2:由于使用了长上下文 VLM,VLA 是否优于其他方案?

RQ3:拓扑图是必要的吗?VLM 可以直接生成动作吗?

演示路线:演示路线通过游戏控制器远程操作机器人采集,所有走廊从相反方向行走两次,最终路线时长约16分钟(每秒1帧,共948帧),并在5:28帧和7:14帧处分别添加了“大家的临时办公桌”和“刘易斯的办公桌”的旁白,实现个性化导航。

多模态用户指令:共收集4类57条用户指令,其中包括20条无需推理的指令(RF),15条需要推理的指令(RR),12条关于小物体的指令(SO),10条多模态指令(MM)。

RQ1:VLA 在现实环境中具有强大的端到端性能

- 极高的端到端成功率

表 2 显示,VLA 在大多数用户指令类别中具有较高的端到端导航成功率,包括以前难以实现的需要推理的指令和多模态指令,并且还具有合理的 SPL(成功率加权路径长度)。

然而,小物体类别的成功率明显较低。

最后,VLA 成功地将个性化叙述融入演示路线。它能够根据来自不同用户的相同指令正确地导航到不同的地点。

- 强大的低级目标到达能力

表 2 还显示了 VLA 对现实世界低级目标达成策略的稳健性,其成功率达到了 100%。

值得注意的是,示范路线是在实验前几个月记录的,当时许多物体、家具和光照条件都与实验中的不同。

- 大规模模拟证实了高端端到端成功率

为了进一步探索端到端性能,研究人员使用模拟来扩大评估次数。

具体来说,我们使用 NeRF 创建办公环境的高保真模拟重建,并在 20 个语言教学任务上对其进行评估,每个任务都有 50 个随机起始姿势。

实验结果表明,高层目标发现率为90%,低层目标到达率为100%,共成功执行900次端到端操作。

- 使用手机导航概括家庭环境

为了证明 VLA 的多功能性和易用性,研究人员在真实的类似家庭的环境中进行了概念验证实验,并使用 Pixel 6 手机记录了演示。

结果显示成功率为 100%,SPL 为 0.87。这表明 VLA:

1. 在任何环境下均能表现良好;

2. 部署极其简单。(用户只需用手机记录环境导航,上传到机器人,然后开始发出指令即可)

研究人员表示,这种多功能性和易用性在机器人导航领域是前所未有的。

RQ2:长上下文多模态 VLM 更适合高级对象查找

- VLA 优于其他方法

表 3 显示,VLA 在查找高级对象的成功率方面明显优于其他方法。

假设低级目标到达成功率为 100%,这些高级目标发现成功率也代表了整体的端到端成功率。

- 使用长上下文 VLM 处理高帧率导航视频是成功的关键

表4显示,随着视频帧率的降低,高级目标发现的成功率也随之降低。(因为较低的帧率会错过重要的导航目标帧)

此外,与最先进的 VLM 相比,只有上下文长度高达 1M 个标记的 1.5 Pro 才能达到令人满意的成功率。

图 3 显示,给定多模态指令“我想要更多这个”和桌子上几个可乐罐的图像,VLA 可以正确识别包含冰箱的框架并引导用户走向它。

基于CLIP的检索方法找到一个包含水瓶和一些杂物的桌子区域,并认为它最接近完整的指令图像,因为使用Owl-ViT很难从指令图像中提取“用户想要的东西”。

GPT-4o 错误地尝试找到最接近指令图像的帧,而 GPT-4V 拒绝给出帧号,因为它找不到包含饮料的帧。

最后,纯文本方法无法理解“这”是指一罐可乐还是办公环境,因为它仅依赖于说明图像的文本描述。

RQ3:拓扑对于成功至关重要

- 拓扑对于成功导航至关重要

表 5 显示了 VLA 在模拟中的端到端性能与直接提示 VLM 输出航路点操作的比较。

端到端成功率为 0%,这表明,如果没有拓扑图,1.5 Pro 就无法在零样本情况下导航机器人。此外,1.5 API 需要在每次推理调用时上传所有 948 张图像,导致每一步的运行时间长达 26 秒,而机器人仅移动 1 米。

相比之下,VLA 的高级 VLM 需要 10-30 秒才能找到目标索引,然后机器人使用低级拓扑图导航到目标,从而形成高度稳健和高效(每步 0.19 秒)的 MINT 解决系统。

谷歌十年血泪史

“机器人时代已经到来,下一波人工智能将是物理人工智能,机器人将越来越多地融入我们的日常生活,一切都将机器人化。”

黄先生在六月份的演讲中预测了人形机器人未来发展的美好前景。

酷炫的赛博朋克风格人形机器人正吸引着亚马逊、谷歌、微软等大型科技公司的密切关注和数亿美元的投资。

马斯克还将特斯拉的未来押注在机器人上,预测机器人“擎天柱”能将市场价值推高至 25 亿美元。

“也许不到十年,人们就能买一个机器人送给父母作为生日礼物。”

当马斯克说这句话的时候,想到自己在烈日下挑外卖、干着家务、满世界找钥匙,有没有感觉稍微轻松一点?

事实上,谷歌的机器人制造之路并非一帆风顺。

早在2012年至2013年,谷歌就一口气收购了包括波士顿动力在内的11家机器人公司。

当时,安卓系统创始人安迪·鲁宾正管理谷歌机器人产品线,谷歌意识到机器人发展前景无限,试图加速AI机器人的商业布局。

当时以软件闻名的谷歌,选择通过收购来最大化整合其并不擅长的硬件领域的技术资源。

谷歌也曾经认为,只要有了硬件基础,再结合自己最擅长的软件,就一定能解决机器人领域的技术壁垒。

然而实际运行中却残酷的发现,机器人的作业精度远远不能满足要求。

比如你是一个公司的大老板,一个成熟的技术员的工作准确率可以达到98%,而机器人的工作准确率则不到90%。

您会聘请一名技术熟练的技术人员,还是购买昂贵且容易出错的机器人,然后雇人来监督和调整机器人?

目前机器人的准确率可以达到80%-90%,最后的10%投入了大量的资金和人力,却看不到回报。

安迪·鲁宾在丑闻发生后离开了谷歌,其收购的公司也分崩离析,波士顿以低于收购估值三倍的价格将它们出售。

可以看出,软硬件设施的制造以及二者的结合成为了机器人制造领域最棘手的难题。

那么,在人工智能大模型热潮中,这是否会给机器人制造业带来希望?具有学习能力的机器人能否实现?

参考:

还没有评论,来说两句吧...