摘要:

界定(2024新澳彩资料免费资料大全)英国南安普敦大学教授温迪·霍尔:AI 发展的漫长历程与未来展望温迪·霍尔:最终报告已经基本完成了并提交给了联合国秘书长,还会有一些反馈意见,可...

摘要:

界定(2024新澳彩资料免费资料大全)英国南安普敦大学教授温迪·霍尔:AI 发展的漫长历程与未来展望温迪·霍尔:最终报告已经基本完成了并提交给了联合国秘书长,还会有一些反馈意见,可... 霍尔上大学时,几乎接触不到计算机。获得数学博士学位后,她对新兴的微型计算机产生了兴趣,于是转攻计算机科学硕士学位,并在毕业时编写了一个智能教学程序。她在7月7日接受澎湃新闻(北京)专访时说,“当时我只是想展望未来,看看我们如何将人工智能与计算机结合起来。”当时,全球人工智能正从理论研究走向实际应用。

英国南安普顿大学教授温迪·霍尔接受了澎湃新闻的专访。

从那时起,霍尔就领导一个团队,于 1988 年开发了微世界超媒体系统 (),该系统将文档之间的链接存储在单独的数据库中,以构建更加互联的网络,这在万维网出现之前就已经存在了。

霍尔说:“从那时起,我就一直在我的职业生涯中使用人工智能。”

20 世纪 80 年代末,在南安普顿大学教授计算机科学 3 年后,霍尔意识到一个奇怪的现象:这个专业没有女学生,英国其他大学也是如此。她回忆说,当时,计算机被包装成男孩的玩具出售,似乎与女性无关。“我们让一代女性对计算机失去了兴趣,而这门学科的性别比例自那时起一直没有完全恢复,因此从事人工智能工作的女性更少了。”

不过,她很高兴联合国的人工智能咨询系统已经注意到了多样性问题。2023年,霍尔入选联合国人工智能高级咨询机构。39名专家中,有20名女性和19名男性,代表33个国家。她强调,如果开发人工智能的团队不多元化,那么就很有可能出现偏见和不公正,因为它只会以单一的方式思考。

霍尔2017年受英国政府邀请,为英国撰写人工智能产业发展路线图,两周前她与时任英国首相苏纳克讨论了人工智能安全问题。过去一年,她与联合国人工智能咨询机构团队成员一直在撰写《以人为本的人工智能治理》报告,最终版本将于今年夏天发布。霍尔教授从英国和联合国机构的角度阐述了人工智能的治理和监管。

人工智能领域的女性

澎湃新闻:您从1984年起涉足人工智能领域,到现在已经40年了。这期间,人工智能的技术和商业应用都发生了巨大的变化。您坚持从事这一学科研究的动力是什么?

Wendy Hall:我是一名数学家,刚获得博士学位时,微型计算机才刚刚出现。我想在研究型大学工作,但因为太年轻,找不到合适的职位,而且我发现自己的能力无法与微型计算机的内存和计算能力相匹配。当我了解到除了编写代码之外,我还可以与计算机交互,并在计算机上添加图形和多媒体时,我对如何将其应用于教育产生了兴趣。后来,我对超媒体()产生了浓厚的兴趣,并开始了我的研究之旅。

二十或三十年前,人们认为计算机科学家杰弗里·辛顿疯了,因为他不断提出新想法,但研究通常就是这样的,这也是我喜欢做研究的原因。我喜欢有人告诉我,我所做的事情永远不会成功,多年后我可以对人们说:“看界定(2024新澳彩资料免费资料大全)英国南安普敦大学教授温迪·霍尔:AI 发展的漫长历程与未来展望,我 30 年前做的事情现在成功了。”我对此感到非常自豪。例如,我在 20 世纪 90 年代谈论过可穿戴计算机设备,有一段我谈论它们的视频,人们问我为什么需要可穿戴计算机,现在它们无处不在。

我不想为科技巨头工作,因为这个行业以利润为导向,必须专注于提高股价和销售产品。我在 20 世纪 90 年代确实创办过几家初创公司,取得了不同程度的成功,但并没有让我致富。我在大学里获得了很好的经历,在那里我可以自由思考并进行我感兴趣的研究。

澎湃新闻:在人工智能领域,像您这样的女性研究人员并不多,您如何提高女性的参与度?

温迪·霍尔:我认为人工智能不应该被视为计算机科学的一个子集,它比计算机科学要大得多。当我们谈论它时,我们谈论的不仅仅是编程,我们还在谈论它的伦理、治理、政策,我们需要立法者、人文研究人员、商界人士、哲学家和心理学家。因此,性别、年龄、种族方面的多样性非常重要,因为人工智能是为全世界而建的。

我很担心人工智能是通过计算机科学选拔人才,而学习计算机科学的女性非常少。因此2024澳门彩开奖结果查询,相应地,从事人工智能的女性就更少了。进入人工智能领域 40 年后,我仍然是该领域为数不多的女性之一。

澎湃新闻:人工智能领域女性研究人员数量较少,是否会导致缺乏多样性并引发其他问题?

温迪·霍尔:我非常提倡多元化,如果只是单一文化,那么产生的任何东西,无论是研究还是产品,都更有可能存在偏见和不公平,因为你只以一种方式思考。如果开发人工智能的团队缺乏多样性,那么从道德角度来看,这是有问题的。

当然,联合国人工智能高级咨询机构的团队非常多元化,男女比例为 50/50,年龄、种族和商业背景也各有不同。所以这是一支优秀的团队,也是多元化的典范。

谁应该领导人工智能规则制定?

澎湃新闻:人工智能高级别咨询委员会的39位专家来自33个不同的国家,代表遍布各大洲。当来自不同国家、不同学科、不同背景的专家共同起草一份报告时,会产生什么样的分歧呢?

温迪·霍尔:因为这个团体是多元化的,各个地区的专家都参与得非常深入,所有专家都敢于说出自己的想法,所以我们并不是事事都意见一致。但这个组织的成功很大程度上要归功于联合国的领导,尤其是联合国秘书长科技特使阿曼迪普·吉尔,他是一个非常有影响力的人物,但他看起来并不高高在上,通常允许每个人按照自己的方式行事,他鼓励人们畅所欲言,真正参与讨论。总的来说,每个人都会畅所欲言,这就是全面的多元化,这让我感触很深。

我特别喜欢听团队里的法律从业者用不同的方式思考世界,非常有逻辑性。我们彼此很了解,有过很多线上线下的会议,包括一些深入的讨论,包括开源、人工智能和平、儿童和性别等各种话题。

澎湃新闻:去年12月,联合国人工智能高级别咨询机构发布《以人为本的人工智能治理》中期报告,呼吁将国际规范与人工智能发展和推广方式更加紧密地结合起来。最终报告尚未发布,请问目前工作进展如何?

温迪·霍尔:最终报告已经基本完成,并提交给联合国秘书长。会有一些反馈,后续可能会更新迭代。最重要的是联合国领导层是否愿意接受我们的建议。我们要用他们能接受的方式坚定地说出我们想说的话。这份报告将作为今年9月未来峰会上讨论的全球数字契约的一部分。我们非常希望报告中的大部分内容都能被纳入契约。

对于报告的细节,我们为联合国和人工智能机构留出了讨论空间和其他可能性。我们访问了世界卫生组织、知识产权组织、人权组织和国际电信联盟(ITU)。他们都在推进人工智能方面的工作,但往往只能看到自己关注的部分。我们正在努力克服这个障碍,而构建网络是一个解决方案。

澎湃新闻:从科研机构、科技公司到各国政府、联合国,都在不同层面讨论、制定人工智能相关规则,尽可能保证安全。那么,在规则制定中,哪一方拥有主导权?

温迪·霍尔:各国政府对规则制定有很大的影响力。例如,英国去年成立了人工智能安全研究所,以提高人们对人工智能安全的认识。但我不赞同这种做法,因为它太过政府部门化,缺乏学术参与。联合国是世界上唯一真正具有普遍性的全球组织,能够处理各种问题。虽然它可能不完善,但我们可以利用这样的平台构建人工智能治理的网络。

澎湃新闻:去年英国举办了国际人工智能安全峰会,时任首相苏纳克表示:“目前,测试人工智能模型安全性的只有开发这些模型的公司。”他认为这远远不够。那么如何让更多人参与到测试和提高人工智能的安全性中来?

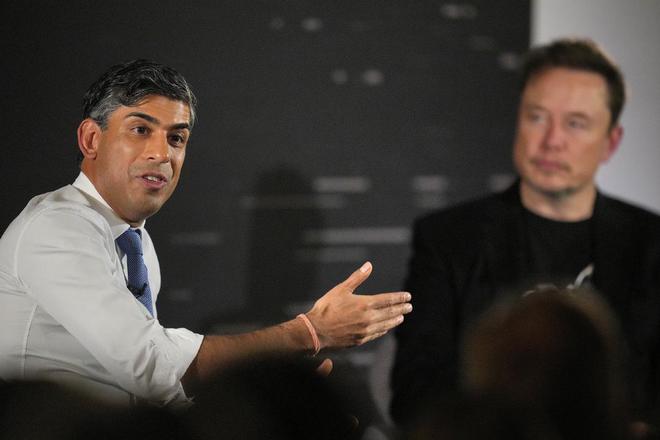

当地时间2023年11月2日,在伦敦人工智能安全峰会期间,时任英国首相苏纳克与特斯拉首席执行官马斯克出席对话活动。

温迪·霍尔:说到去年在英国举行的人工智能峰会,坦率地说,让我恼火的是很多国家没有被邀请,邀请的标准不明确,很多学者被完全排除在外。

关于人工智能的安全,在很多行业,业界一般会开发测试工具来测试产品,然后向政府提交报告进行监管。这也是人工智能目前遵循的一套规则。在英国,人工智能安全研究所可能都无法接触那些科技公司的数据,更别说其他机构和个人了。我认为公司管理安全和政府监管之间的平衡需要进一步优化。

两周前我和苏纳克首相见面,我们谈到了人工智能,我问他成立人工智能安全研究所的目的是什么。他非常热情地表示,英国可以成为人工智能安全领域的领导者,但实际上这是一个全球性问题。我认为很多研究应该在大学里进行,由商业公司出资,然后政府应该监管这项技术的发展,政府需要派人到人工智能的最前沿,了解正在发生的事情,并对其进行监管。

不要让我做简单的数学题

澎湃新闻:您参与了2017年英国人工智能独立报告的制定,也参与了联合国人工智能高级别咨询机构的人工智能治理工作。您如何看待欧盟最新的人工智能法案?一些科技公司指责这样的法案破坏了创新。您怎么看?

温迪·霍尔:我们必须在创新和监管之间找到正确的平衡。我认为英国的做法过于宽松,但也更有利于创新。其实无论是欧盟还是英国,确保安全的目标都是一样的,只是实现的手段不同。

我们必须有强有力的监管。科技公司自我监管是不够的。就像烟草行业一样,人们知道吸烟的危害,但如果没有相关的监管,烟草公司就会以自己的方式制造和销售香烟以牟利。不同国家的法律会有所不同,但我们需要在联合国层面形成某些原则,每个国家都可以根据这样的原则制定自己的法规。

澎湃新闻:您在社交媒体上发布了一封关于深度伪造的联名信,呼吁制定新的法律法规保护人们免受深度伪造的危害。深度伪造的哪些危害值得特别关注?应对这些危害应从哪些方面着手?

Wendy Hall:我们可以看到今年有很多国家都在举行选举,我们非常担心深度造假会改变人们在选举中的投票结果。这个问题很难通过任何法律或技术来解决。比如有专家提到可以用水印来防止伪造,但实际上水印也很容易被破解。

我认为每个人都应该意识到人工智能能做什么,以及它如何被滥用来制造虚假信息和深度伪造。我们不能指望政府包办一切,我们也不希望政府和科技公司成为审查者。真正的困难是谁来决定某件事或某条信息的真实性,这也涉及言论自由和隐私问题。所以这还是回到人们的意识上,每个人都需要意识到应该如何正确使用人工智能。

澎湃新闻:您在演讲中提到生成式人工智能工具已经发生了很大变化,请问在开发和使用生成式人工智能过程中,需要注意哪些风险或者盲点?

温迪·霍尔:我想强调人工智能的能耗问题。它巨大的电力需求令人担忧。人们经常不恰当地使用生成式人工智能,用于极其简单的请求,比如输入简单的算术问题,这很疯狂。我们需要负责任地使用人工智能。一些可以在搜索引擎中找到的信息,不需要用资源密集型的生成式人工智能来完成。当公司销售产品时,他们不应该说现在你可以用它做所有事情,而应该思考如何确保以负责任的方式使用它。

当然,我对人工智能的发展还是持乐观态度的,重要的是看如何与人工智能合作。比如,人工智能在粮食安全、气候变化、能源、医疗保健等方面取得了很多突破,这是一个很大的进步。我们要支持人工智能向正向发展,建立机制,确保安全。这是一个漫长的路程。我们不应该反对人工智能,而应该与它合作,因为人工智能可以帮助人类拥有更好的未来。

还没有评论,来说两句吧...